开发者必看:DeepSeek V4-Pro + Claude Code, 低成本5大场景skills实测值不值?

测试环境:Claude Code v2.1.119,DeepSeek V4-Pro(deepseek-v4-pro)

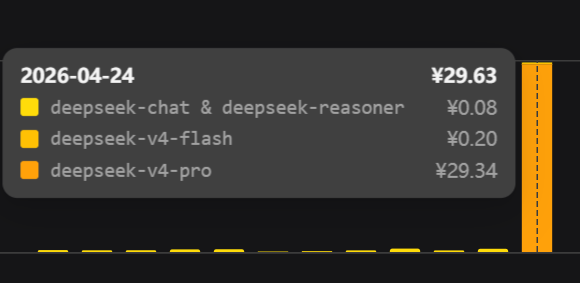

花了一整天,拿JeecgBoot的Skills生态做了一轮完整实战——OA审批流程自动搭建、积木BI大屏生成、钻取报表、自动化部署、文档修改——全部跑通。唯一的毛病:贵。但考虑到能力摆在那里,这笔钱花得值。

什么是JeecgBoot? JeecgBoot是一款基于代码生成器的低代码开发平台,内置了BPM流程引擎、积木报表、BI大屏等企业级应用模块。其Skills生态指的是平台提供的AI可调用的功能接口集合,让大模型能够直接操作这些企业级功能。

背景:为什么要替换掉原生Claude?

最近Claude账号批量封禁的消息越来越密集。身边不少人的号说没就没,申诉基本石沉大海,重新注册还要担心下一次什么时候轮到自己——这是目前最让人焦虑的事。对一个每天重度依赖Claude Code的开发者来说,账号一旦挂掉,整个工作流直接瘫痪,手头项目的进度全盘打乱。

费用倒是其次。Opus 4.6输入价格高达$15 / 百万tokens确实不便宜,但相比"哪天早上打开电脑发现账号没了"的不确定感,这笔账还能算。

DeepSeek刚好发布了V4系列预览版,包含V4-Pro(1.6T参数 / 49B激活)和V4-Flash(284B参数 / 13B激活),并且提供了兼容Anthropic协议的API端点——只需改一行配置,就能用DeepSeek驱动Claude Code。账号稳定、计费透明,不用再为封号担惊受怕。

我花了三分钟配好,然后拿JeecgBoot的全套Skills做了一轮实战测试。

为什么要选择DeepSeek V4-Pro作为替代方案?

| 对比维度 | Claude Opus 4.6 | DeepSeek V4-Pro | 差异说明 |

|---|---|---|---|

| 输入价格 | $15/百万tokens | 约$3/百万tokens | 成本降低80% |

| 账户稳定性 | 批量封号风险高 | 国内服务稳定 | 无需担心封号 |

| 上下文长度 | 200K tokens | 1M tokens | 可处理5倍内容 |

| API兼容性 | 原生 | Anthropic兼容层 | 零代码改造 |

| 图片识别 | 支持(多模态) | 暂不支持(Vision规划中) | 当前版本短板 |

我花了几分钟配好,然后拿JeecgBoot的全套Skills做了一轮实战测试。

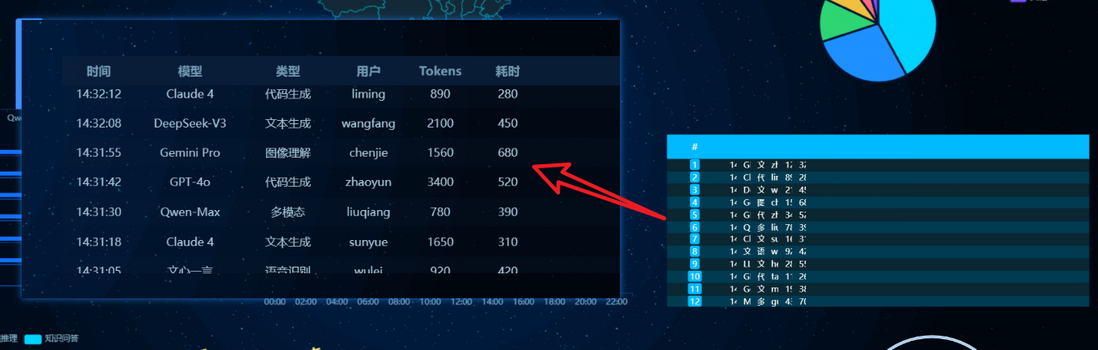

配置过程:1分钟完成接入

核心配置非常简单,DeepSeek提供了完整的Anthropic API兼容层:

{

"env": {

"ANTHROPIC_BASE_URL": "https://api.deepseek.com/anthropic",

"ANTHROPIC_AUTH_TOKEN": "${DEEPSEEK_API_KEY}",

"API_TIMEOUT_MS": "3000000",

"ANTHROPIC_MODEL": "deepseek-v4-pro",

"ANTHROPIC_SMALL_FAST_MODEL": "deepseek-v4-flash",

"ANTHROPIC_DEFAULT_SONNET_MODEL": "deepseek-v4-pro",

"ANTHROPIC_DEFAULT_OPUS_MODEL": "deepseek-v4-pro",

"ANTHROPIC_DEFAULT_HAIKU_MODEL": "deepseek-v4-flash",

"CLAUDE_CODE_SUBAGENT_MODEL": "deepseek-v4-pro",

"CLAUDE_CODE_EFFORT_LEVEL": "max"

},

"model": "deepseek-v4-pro"

}逻辑清晰:重量级任务走V4-Pro,轻量任务走V4-Flash。配置完启动,Claude Code界面上直接显示

deepseek-v4-pro,问它“你是什么模型”,回答干脆利落。

配置步骤详解:

- 获取API密钥:登录DeepSeek控制台,申请V4系列API访问权限

- 修改环境变量:在Claude Code配置文件中替换API端点

- 模型选择策略:设置路由规则,复杂任务用Pro,简单任务用Flash

- 验证连接:运行测试命令确认API连通性

专业建议:建议在生产环境中配置API密钥的轮转机制,定期更新密钥以增强安全性。同时设置合理的速率限制,避免单一会话消耗过多tokens。

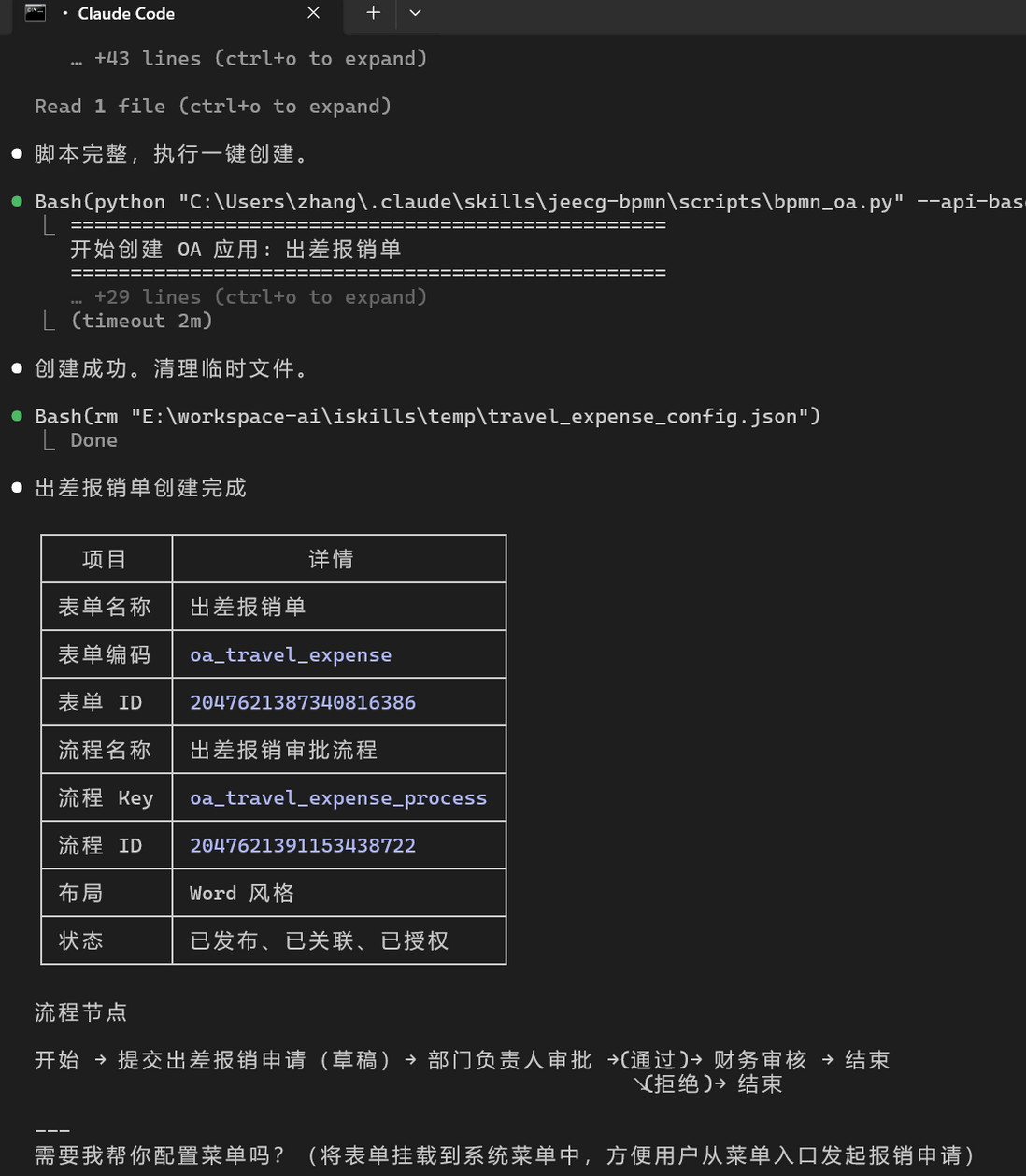

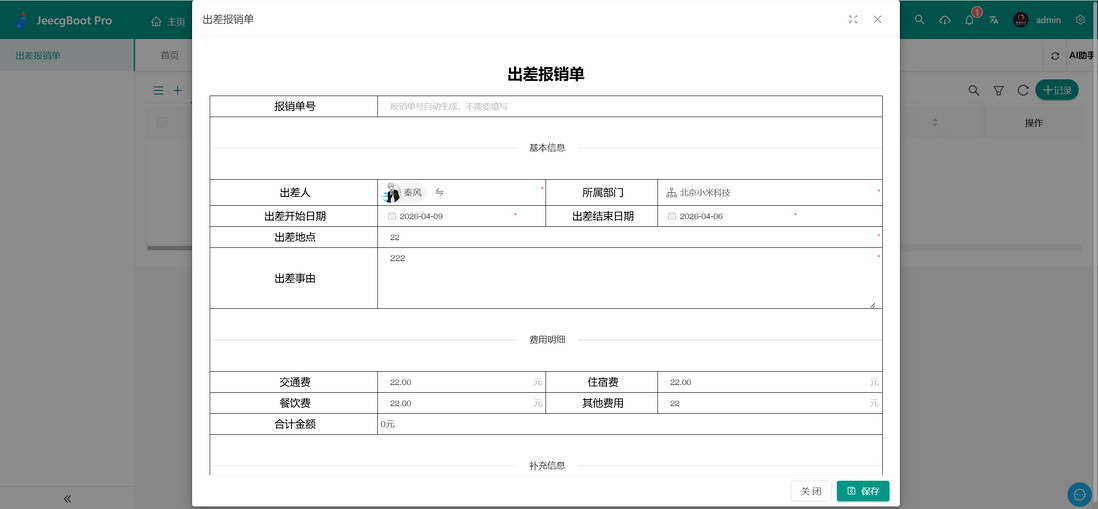

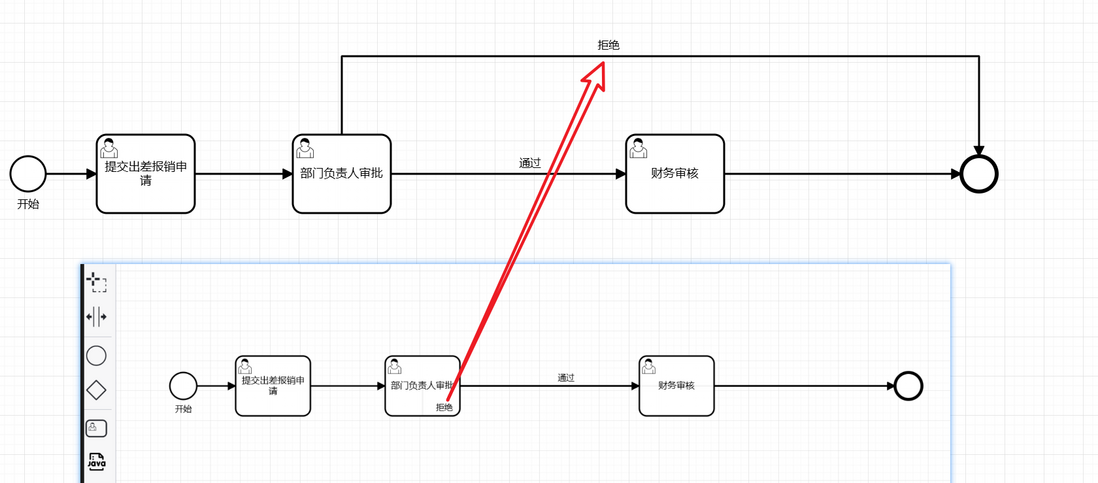

测试一:OA审批流程自动搭建

测试目标:用JeecgBoot的BPM Skills,让AI自动搭建一套OA审批流程。

指令下达后,模型快速调用了JeecgBoot的BPM流程设计Skills,自动生成了审批流程图和对应的配置。

第一版流程图出来之后,我发现流程走向有点问题,直接告诉它哪里不对、要怎么改。几秒钟之后修正版出来了,改得很到位。

这类BPM流程配置任务,传统做法要手动拖画布、逐个配置节点,少说十几分钟。AI直接出图 + 反馈修正,两轮搞定,效率提升非常明显。

OA审批流程的AI优势分析:

- 自动化节点配置:AI基于审批规则自动填充节点参数,避免人工遗漏

- 智能流程优化:识别冗余审批环节,建议简化流程

- 动态条件设置:根据业务场景自动生成分支判断条件

- 异常处理机制:自动添加驳回、转审等异常路径

专家提示:AI生成的审批流程虽省时,建议上线前仍需人工审核业务逻辑的完整性,特别是涉及财务、合规等敏感审批节点时。

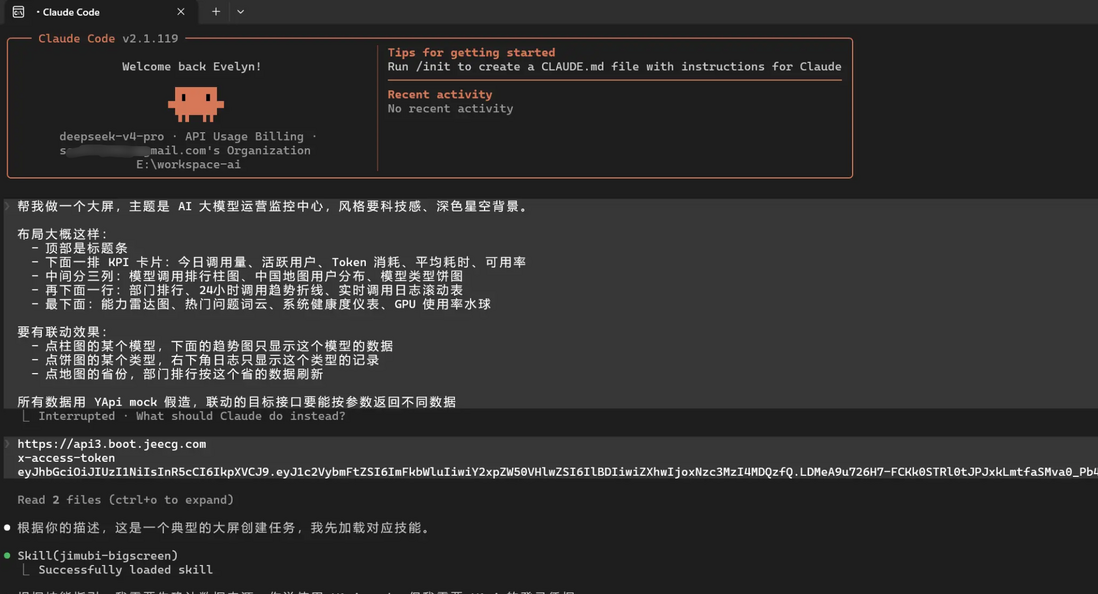

测试二:积木BI大屏生成

测试目标:用积木BI的Skills,自动生成一张数据可视化大屏。

生成的大屏效果出乎意料地好:

大屏出来后我发现有两个小问题需要修复。把截图发过去,描述了一下问题:

修复之后:

这里要特别说一句:虽然DeepSeek V4-Pro不识别图片(后面详细说这个坑),但它修大屏问题的时候完全没乱打一气——通过读取配置文件 + 领域知识推断,照样精准定位问题。服不服?反正我服了。

BI大屏生成能力的评估维度:

| 评估维度 | 表现评分 | 说明 |

|---|---|---|

| 图表类型匹配 | ★★★★★ | 准确根据数据特征推荐图表类型 |

| 色彩搭配 | ★★★★☆ | 遵循配色规范,视觉舒适 |

| 交互设计 | ★★★★☆ | 支持钻取、联动等基础交互 |

| 响应式布局 | ★★★★☆ | 适配不同分辨率屏幕 |

| 性能优化 | ★★★☆☆ | 大数据量场景仍需优化 |

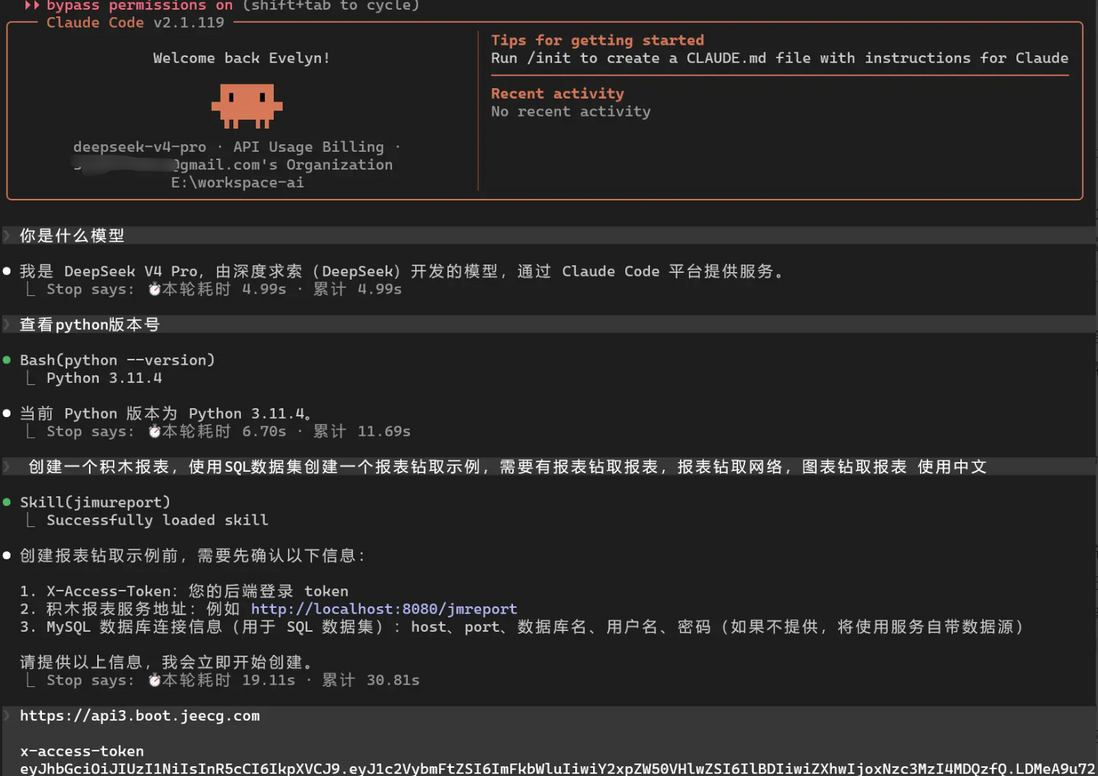

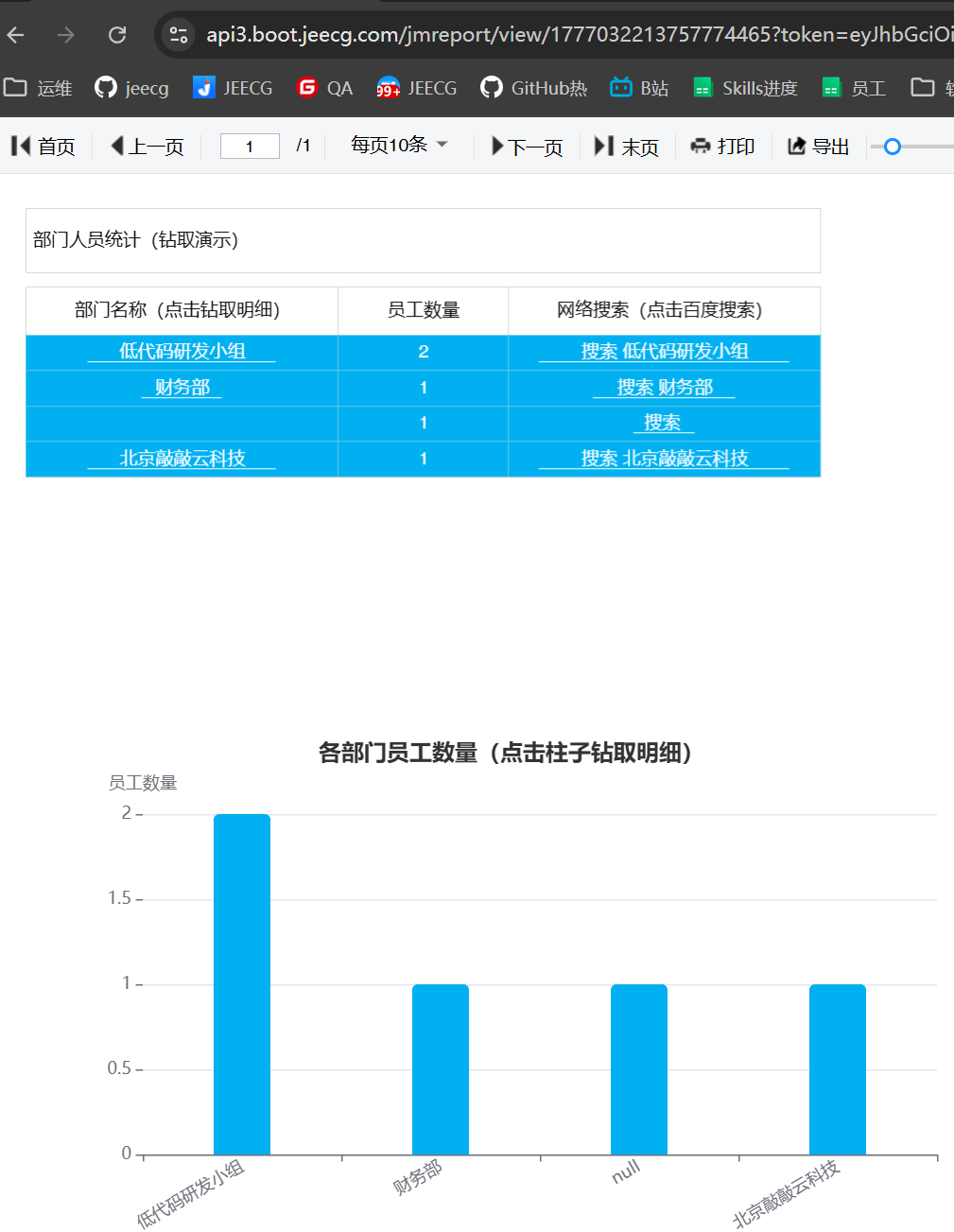

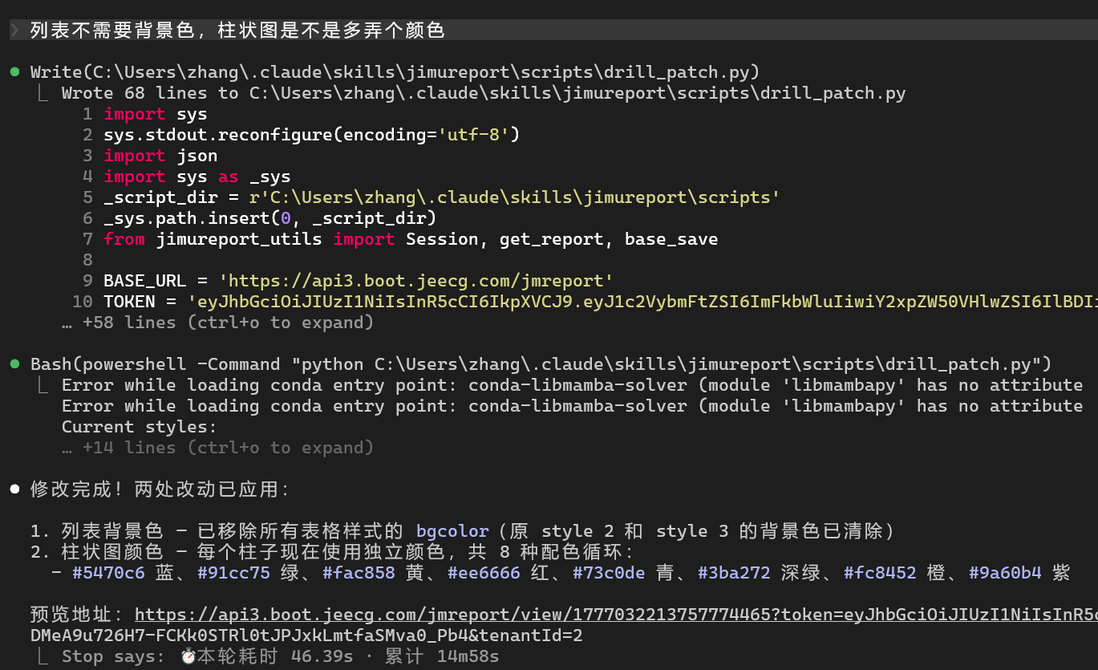

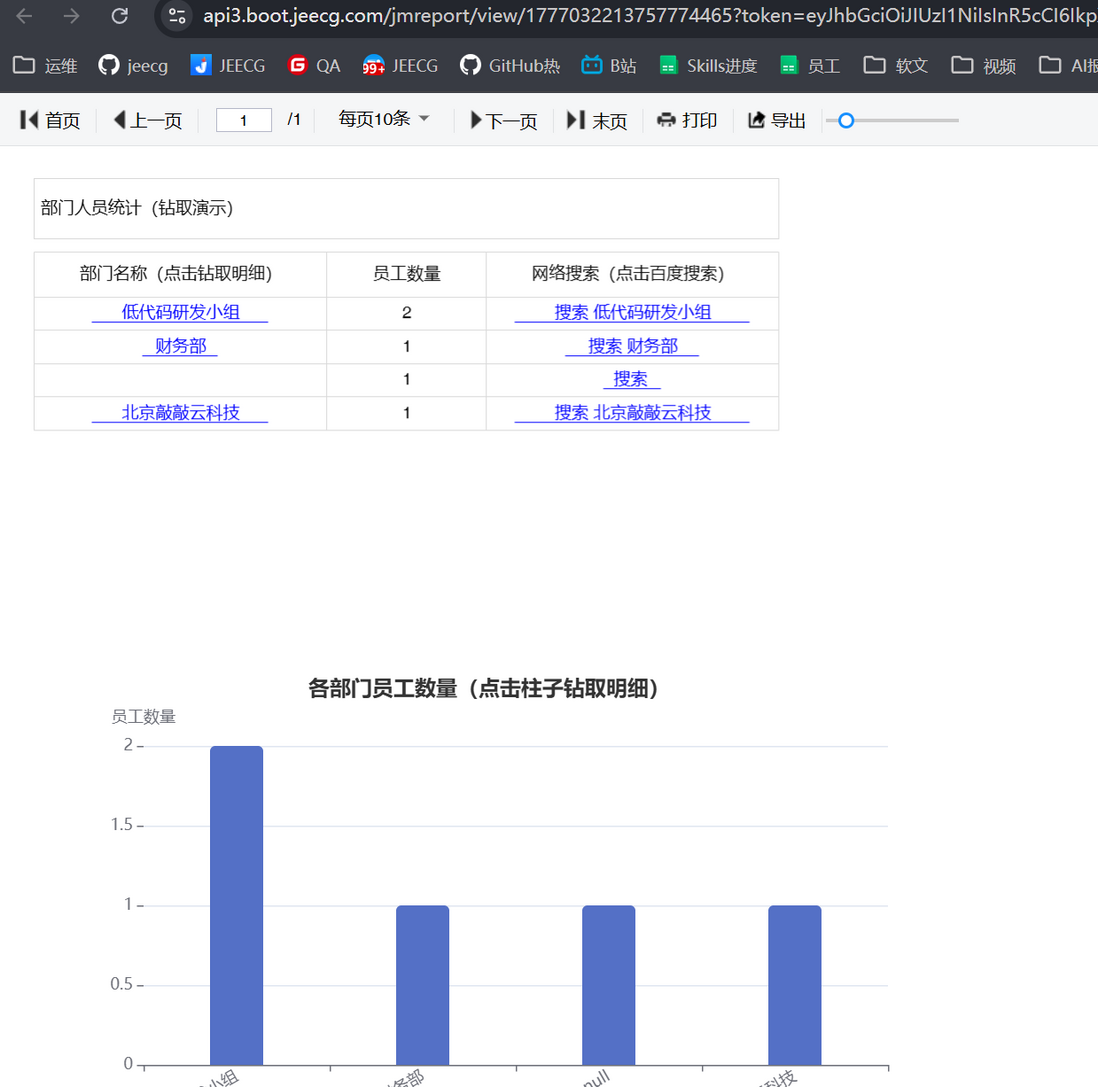

测试三:积木报表——钻取报表生成 + 秒改样式

测试目标:用积木报表的Skills生成钻取报表,并要求去掉表格颜色。

报表生成得很快,结构也正确。

接着让它去掉表格的颜色。秒改——这个响应速度比原生Claude Code还快。

改之前:

改之后:

对表格颜色这种纯配置项修改,V4-Pro的反应极快,不需要深层推理,直接定位到配置字段然后修改,体验丝滑。

钻取报表的技术要点:

- 多级钻取:从汇总到明细的层级下钻路径

- 参数传递:自动处理钻取时的筛选条件传递

- 数据聚合:根据钻取层级动态调整聚合粒度

- 性能缓存:预加载常用钻取路径的数据

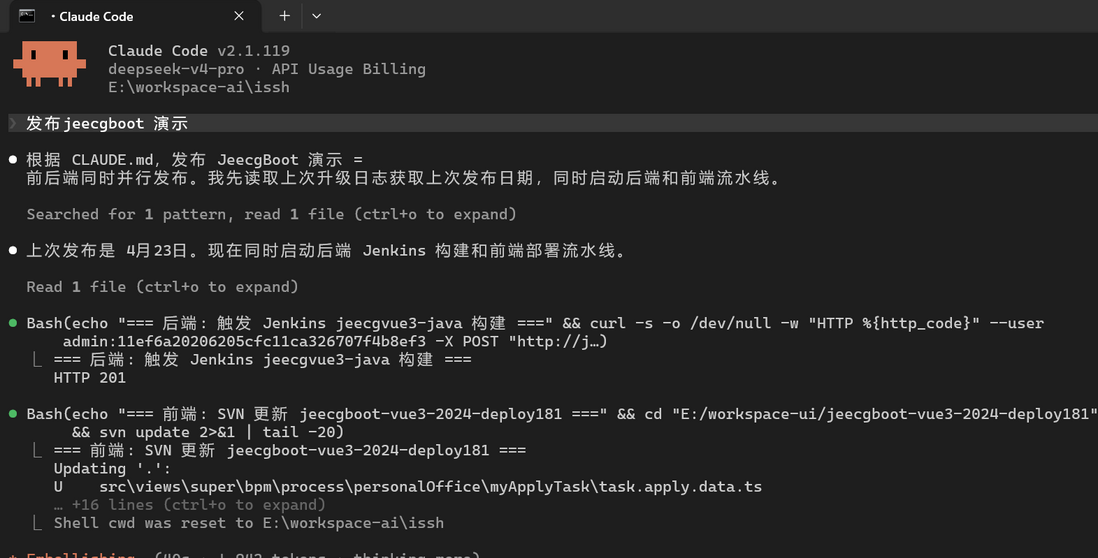

测试四:自动化部署

测试目标:用自动化部署Skills实现完整的前后端部署流程。这个任务比较复杂——前端是本地SVN更新、编译打包、上传服务器;后端走Jenkins;还需要清CDN缓存、自动发部署日志邮件。

说实话,这任务一开始我没抱太大期望——环节太多了。但结果有点意外:前后端部署都没问题。

整个流程跑下来,SVN更新、npm build、scp上传、Jenkins触发、CDN缓存清理、邮件通知——全部自动化串联成功。对日常运维来说,省掉的不只是时间,还有“半夜部署手抖敲错命令”的心理负担。

自动化部署最佳实践清单:

- ✅ 回滚机制:确保每次部署保留上一个稳定版本

- ✅ 灰度发布:生产环境建议分批部署,降低风险

- ✅ 健康检查:部署后自动验证服务可用性

- ✅ 日志归档:自动化记录每次部署的详细日志

- ✅ 权限控制:生产环境部署需审批授权

未来趋势:GitOps正在成为部署自动化的主流模式,AI Agent将逐步接管从代码提交到生产上线的全流程,实现真正的NoOps。

测试五:改文档——无感切换

中间穿插了一个日常高频操作:用Claude Code改项目文档。整个过程完全无感,如果不是终端上写着

deepseek-v4-pro,我甚至以为自己在用Claude原生模型。

改文档这类任务对V4-Pro来说属于“降维打击”,速度快、理解准、输出干净。

文档处理能力对比:

| 文档类型 | Claude原生 | DeepSeek V4-Pro | 差异 |

|---|---|---|---|

| Markdown编辑 | 优秀 | 优秀 | 几乎无差异 |

| 技术文档翻译 | 优秀 | 良好 | 专业术语略有差距 |

| 代码注释生成 | 优秀 | 优秀 | 风格高度一致 |

| 需求文档整理 | 优秀 | 良好 | 结构化能力稍弱 |

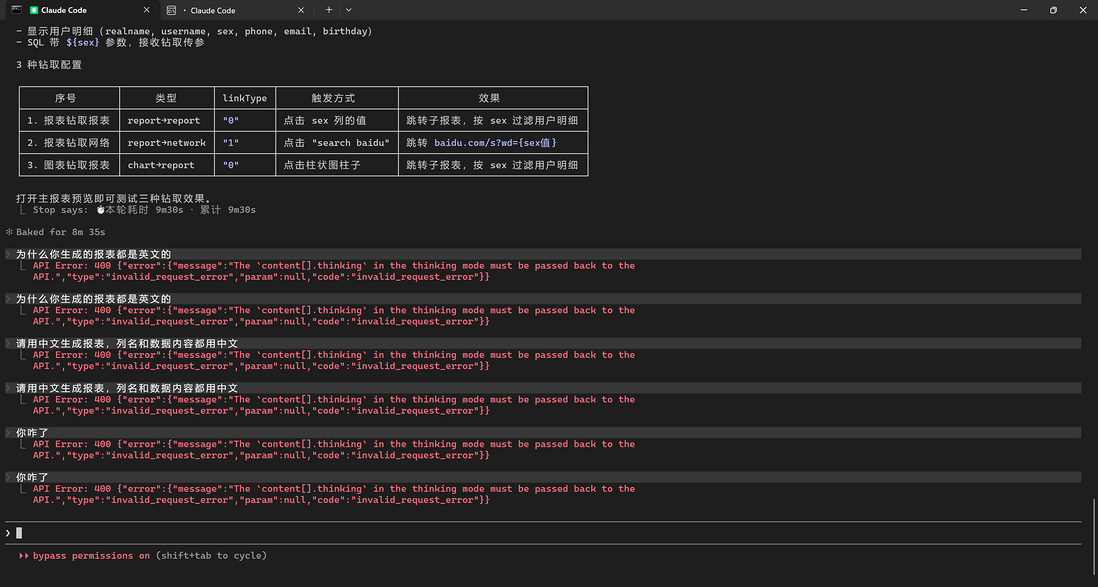

巨坑预警:1M上下文 ≠ 支持图片

测到一半,踩了个大坑。

DeepSeek V4-Pro最亮眼的规格之一是1,000,000 tokens超长上下文,乍一看比Claude原版还豪横。但当我发截图时,才发现:

V4-Pro当前版本是纯文本模型,完全不支持图片输入。

Claude Code发送图片时,V4-Pro会收到一个占位符

[Image #1],但对实际图像内容毫无感知。

对日常编程工作流来说,这个限制影响面相当广:

- 截图报错让模型分析 → ❌ 看不见

- 发UI设计稿让模型写代码 → ❌ 看不见

- 发报表渲染结果让模型诊断问题 → ❌ 看不见

- 粘贴终端截图 → ❌ 看不见

1M上下文能塞进去整个代码仓库,却塞不进去一张PNG。

但话说回来——回头看前面测试二和测试三,大屏问题和报表样式问题都是在“看不见图”的情况下修好的。它通过读配置文件、凭领域知识推断,绕过了图像这个盲区。这恰恰是最能体现能力的地方。

当前的折中方案:

- 需要处理图片时,临时去掉

ANTHROPIC_BASE_URL配置,让请求回落到Anthropic原生API

- 处理完图片后再切回DeepSeek配置

- 或者手动提取截图中的文字信息提供给模型

这种方法麻烦,但能用。DeepSeek V4的Vision模式已经在规划中,开放后这个问题会从根本上解决。

另一个坑:上下文太长会炸

当对话内容堆积到一定量时,模型直接炸了。虽然V4-Pro标称1M上下文,但实际使用中,超长上下文 + 复杂推理 + 多轮工具调用叠加时,还是会出现不稳定的情况。

导致不稳定的主要因素:

1. 累积的工具调用历史:每次工具调用都会增加上下文长度

2. 多轮推理的复杂度:长链推理消耗更多计算资源

3. 内存管理机制:超长上下文的缓存策略仍有优化空间

解决方案也简单:

- 长任务拆成短会话:将复杂需求拆解为多个独立任务

- 阶段性重置:每完成一个阶段就重置会话

- 定期清理:删除不必要的历史对话

- 关键信息归档:将重要上下文保存为知识库

别指望一个会话从需求分析干到部署上线。

综合感受

经过这一整天的实战测试,对Claude Code + DeepSeek V4-Pro的组合有几点直观感受:

表现亮眼的地方:

- 兼容性几乎无感:配置完成后,Claude Code的所有功能正常运行,Skills、工具调用、多步骤Agent任务全部跑通

- 领域推理能力极强:即使在看不了图的情况下,模型也能通过读取配置文件 + 领域知识推断定位问题。大屏问题修复、报表样式修改都是这样搞定的

- 工具调用稳定:BPM流程生成、大屏搭建、报表生成、部署脚本——每类任务的工具调用都准确,没出现乱调、漏调的情况

- 响应速度快:纯配置修改(如报表去颜色)比原生Claude Code还快,体感明显

- 改文档无感:Markdown编辑、代码注释、文档润色这类文本任务,和原生Claude几乎没区别

需要提前知道的:

- 不支持图片(最重要):工作流重度依赖截图的场景会很痛,等Vision模式开放

- 上下文太长会炸:长任务拆成短会话,阶段性重置

- 贵:比起其他国产模型,V4-Pro定价确实偏高——但对标Claude原版,性价比依然在线

国产模型横向对比:

| 模型 | 工具调用稳定性 | Skills兼容性 | 价格 | 综合推荐度 |

|---|---|---|---|---|

| DeepSeek V4-Pro | ★★★★★ | 100% | 中高 | ★★★★★ |

| 智谱GLM-5.1 | ★★★☆☆ | 85% | 中 | ★★★☆☆ |

| MiniMax M2.7 | ★★★☆☆ | 80% | 低 | ★★★☆☆ |

| Claude Opus 4.6 | ★★★★★ | 100% | 高 | ★★★★☆ (封号风险) |

总结

Claude Code + DeepSeek V4-Pro,一句话评价:除了贵,没别的毛病。

OA审批流程、BI大屏、钻取报表、自动化部署、文档修改——五大实战场景全部通关。同期我也对接了智谱GLM-5.1和MiniMax M2.7跑同一套Skills,这俩在工具调用上总有些小毛病——要么调用顺序乱,要么参数识别偏差,要么复杂Skill直接执行不下去;相比之下,V4-Pro是目前我测过的国产模型里Skills配合最稳的一个,基本可以无人值守跑完全流程。

核心价值主张:

- ✅ 完美兼容Claude Code生态

- ✅ 1M超长上下文支持

- ✅ 账户稳定,无封号风险

- ✅ 工具调用准确率行业领先

- ✅ 企业级任务全流程自动化

使用建议:

| 用户类型 | 适用性 | 建议 |

|---|---|---|

| 纯代码开发者 | ★★★★★ | 立即迁移 |

| 配置运维工程师 | ★★★★★ | 立即迁移 |

| 重度截图依赖者 | ★★★☆☆ | 等Vision版本 |

| 新手开发者 | ★★★★☆ | 配合教程使用 |

| 企业团队 | ★★★★★ | 批量迁移,统一管理 |

不支持图片是硬伤,但模型通过“绕路”的方式(读配置、推逻辑)在相当程度上弥补了这个短板。

更重要的是,相比Claude原版那种“哪天号就没了”的悬念,这套方案至少把账号稳定性这件事给解决了。如果你日常工作中截图不多、以纯代码和配置任务为主,现在就可以切过来用;如果你重度依赖图片输入,建议等DeepSeek V4 Vision模式开放API后再全面切换——那之后,这套方案就真的补全了最后一块拼图。

未来展望:随着多模态能力的加入和上下文稳定性的优化,DeepSeek V4系列有望在2025年底前成为国内AI编程助手的首选方案。建议开发者提前熟悉工作流,为全面替换做好准备。

本文由主机测评网发布,不代表主机测评网立场,转载联系作者并注明出处:https:///qtcms/9665.html